AI 编程到底行不行?500+ 开发者的一线答案

一个开发者用 AI 做了一个 Farcaster 上的 NFT 小应用 Cryptosaurus——用户上传头像,AI 生成恐龙风格的 NFT。

原型用了 1 小时。上线用了 100 小时。

那 99 小时花在哪了?AI 写的 UI 翻来覆去改了好几版配色,每次都过度设计。图片生成的 prompt 迭代了 200 多轮(背景里冒出随机文字、恐龙的胡子长得不对、帽子消失)。部署到 AWS 时,AI 不断创建新的 S3 桶,而不是用已有的那个。上线当天,AI 写的智能合约忘了处理并发交易的 nonce 问题,用户付了钱没收到东西,开发者不得不退款并额外补偿 1 美元。

他最后写道:"那些说自己 30 分钟 vibecode 出一个 app 的人,要么是在做已有项目的翻版,要么做出来的东西一堆 bug,要么就是在刷流量。"

最终成绩:1000+ 下载,180 个付费用户。代价:100 倍于原型的时间。

HN 455 条评论里最出乎意料的发现:AI 编程的效果跟团队规模严重相关,而且几乎是反过来的。

先看真实自报数据:

| 开发者 | 背景 | AI 提效倍数 | 备注 |

|---|---|---|---|

| FAANG 工程师 | 大型已有代码库 | 0x | "到现在没一个 AI commit 能直接提交" |

| Amazon 工程师 | Kiro + Opus 4.6 | 2-4x 工作 / 10x 副业 | 吐槽内部工具不如 Claude Code |

| 10 年经验全栈 | 3 人团队 10 万 DAU | 3 人 = 以前 10 人 | "没有 bug 清单,代码质量不比手写差" |

| 20 年 DevOps 老兵 | 金融科技 | 原型 10x / 生产 2-3x | "测试该跑多久还是多久" |

| 独立开发者 | Terraform,全新+已有项目 | 5x | "每周丢两次线索,每月倒退一周以上" |

最后那个人的自述特别诚实:"我一开始只在讨厌的事情上用 AI,后来到处都用。速度确实快了 5 倍。大部分时候我能跟上。每周两次我意识到自己完全不知道代码在干嘛。每月一次它让我倒退一周以上。"

而那个 3 人 10 万 DAU 的案例特别值得细看。这个团队不是在"vibe coding"——3 个人里 2 个完全理解代码库,产品人员可以直接从 Slack 提交配置修改的 PR。过去同样的事至少要 10 个工程师。

但马上有人泼了冷水:"10 万 DAU——你们的竞争对手 1-2 个人抄一份,卖你十分之一的价,6-9 个月你就没了。"

这个分裂不是偶然。AI 擅长绿地开发,不擅长维护已有系统。 项目越新、架构越简单、约束越少,AI 越猛。代码库越老、历史包袱越重,AI 的幻觉造成的破坏越大。

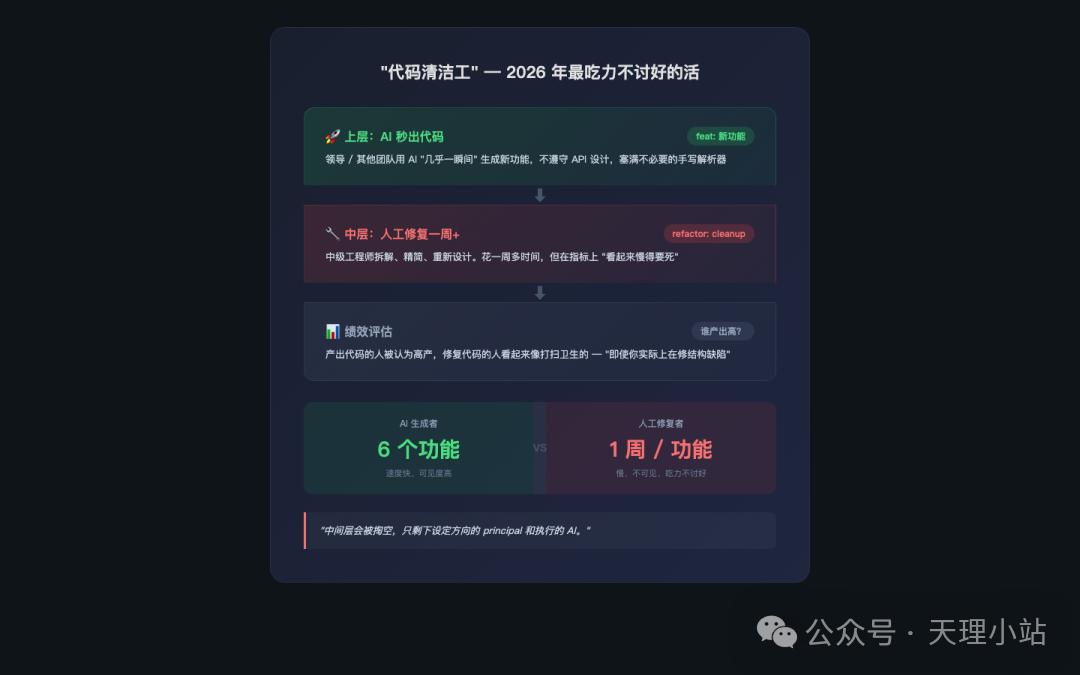

455 条评论里点赞最高的主题之一。一位中级工程师的讲述让人心凉:

"现在上面的人什么都用 AI 做——不只是代码——然后丢给我收拾。代码库一团糟。有一次我要合并另一个团队的功能,但那个功能是 AI 写的,完全不遵守主项目的 API 设计。还包含了一堆第一版根本不需要的东西——大量手写的错误处理和解析器。我花了一周多时间拆解、精简、重新设计。而那个团队 '几乎一瞬间' 就写出来了,我看起来慢得要死。"

然后他做了一个沉重的预测:"我觉得对我这个位置的人来说,未来很暗淡——不是初级,但也不是带队的。中间层会被掏空,只剩下设定方向的 principal 和执行的 AI。"

另一个人回复:"这大概是近期最吃力不讨好的活了。你做的很难,但得到的认可跟工地上打扫卫生的差不多——即使你实际上是在修结构缺陷。"

而管理层那边?一位开发者吐槽:领导用 Claude 生成 50 页设计文档、PRD、幻灯片,发过来说"尽快审阅"。没人读,包括写的人自己。 被问到具体问题就含糊其辞。

另一位更具体:"以前 30 分钟搞定的事,现在要一周。比如数据库有性能问题,以前我直接建个索引就完了。现在变成了 37 页的文档——解释、风险评估、迁移计划、部署方案、障碍分析、一堆评论。看起来确实很专业。"

有人一针见血地总结了这个新社交契约:"你花多少精力生产信息,我就花多少精力消费它。你用 AI 拉了一堆数据出来,我也用 AI 来处理这些数据。"

回复:"经典囚徒困境!"

这可能是所有评论里最深刻的一条(mrothroc):

"最后 20% 不只是难。它之所以难,是因为前 80% 发生的事。当 AI 在前期走了一个捷径,下一步并不知道那是个捷径……到了第 80 小时,你坐在那试图修一个看起来是 UI 的 bug,然后发现真正的问题在三层之下。"

另一位开发者 stainlu 补充了一个很少有人提到的角度:

"人类写的代码通常有一套固定的坏习惯,你学会了作者的盲点就能快速排查。AI 生成的代码表面上更正确,但出错的地方是随机的、不相关的——没有规律可循。而且'为什么这么写'的原因,存在于一段没保存的聊天记录里。"

还有人用了一个绝妙的比喻:"我越深入用 Claude Code,越觉得它像世界上最不稳定的高尔夫球手。一杆就能打到离洞口几步的距离,然后花几小时、几天、几周来推最后那一杆。"

评论区的真实恐怖故事也不少:

最震撼的可能是这条(来自一家上市公司员工):

"我们公司(上市公司,知名品牌,<5000 人)全面押注 AI,目标是一年内 100% 的代码由 AI 生成。跟其他地方一样的成功和失败……但技术领导层坚信这既可行又必要,听不进反对意见。各个层级不同意的人都被请走了。"

"说到底,如果我在那坚持说 AI 质量有多差,但旁边用 AI 的同事已经发了六个中型功能,这个争论我赢不了。"

"领导对事故的态度是'那就写更好的代码'……确实,AI 写的代码有问题、漏掉业务需求。但在产品团队眼里?这不就是跟工程师打交道的日常嘛,他们根本分不出区别。"

有人回复点出了两难:"要么他们是对的(100% AI 代码很快实现),那你反正要失业。要么他们是错的,但到那时候聪明人早走光了。你能看到第三种未来吗?"

同样是用 AI,为什么有人体验 10x,有人体验 0?

独立开发者 Stavros 在博客上分享了他的工作流——用 AI 构建了多个产品,数万行代码,稳定运行。秘诀不是"更好的 prompt",是一套四角色分工:

| 角色 | 模型 | 职责 |

|---|---|---|

| 架构师 | Opus | 反复讨论方案(有时 30 分钟),说"approved"才往下走 |

| 开发者 | Sonnet | 严格按计划执行,不自由发挥 |

| 审查者 | Codex / Gemini | 用不同模型审查——"让模型审查自己的代码,它基本会同意自己" |

| 仲裁 | Opus | 审查者意见冲突时做最终决策 |

100 小时那个帖子里也有人总结:"他停止用 prompt 直接写代码、打开 Figma 开始真正设计的那一刻,Claude 的实现质量飞跃了。瓶颈从来不是代码生成,是在生成之前就该发生的思考。"

HN 上另一个很好的做法来自 citizenkeen:"我们团队都用 Claude,但我有一条严格规定:我们不说'我问了 Claude'。用可以,但你必须为产出负责。"

高效使用 AI 编程的人有一个共同点:他们把 80% 的时间花在 AI 动手之前。

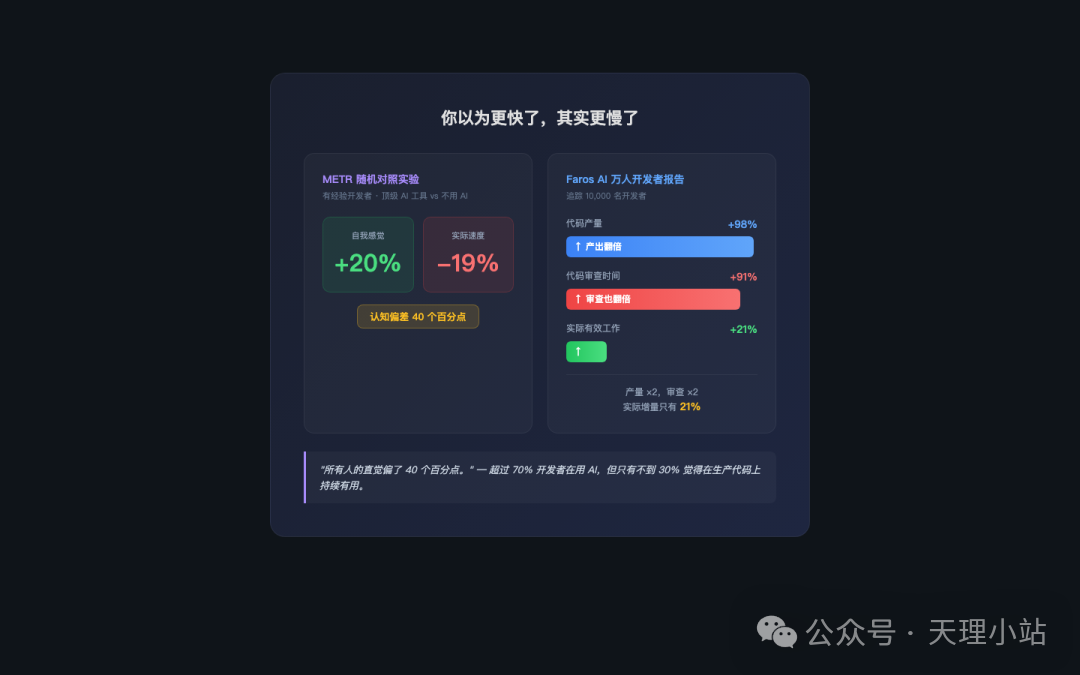

METR 做过一个随机对照实验:让有经验的开发者分两组,一组用顶级 AI 编程工具,一组不用。

结果:用 AI 的那组反而慢了 19%。

更扎心的:同一批人自我评估觉得自己快了 20%。

所有人的直觉偏了 40 个百分点。

Stack Overflow 2025 年调查也印证了这一点:超过 70% 的开发者在用 AI 工具,但只有不到 30% 觉得它在生产代码上持续有用。66% 的人经历了"生产力税"——AI 省下的时间,被审查和修正吃回去了。

Faros AI 追踪 10,000 名开发者给出了更精确的数字:用 AI 的团队代码产量增加 98%——但代码审查时间也增加了 91%。最终实际多完成的有效工作?只有 21%。

一位不用 AI 的开发者观察同事后说了一段话,听起来像在描述上瘾:

"六个月前一个同事就跟我承认了这件事——他在试着不再用 AI 写代码,但很难停下来,因为太容易顺手就用了。听起来有点像药物成瘾。 另一个初级同事过去一年好像变笨了,提交的 PR 根本没解决问题。"

基于这上千条评论,我整理了一张表:

| 场景 | 效果 | 建议 |

|---|---|---|

| 全新个人项目 | ⭐⭐⭐⭐⭐ | 原型放心用,但留 100 倍时间给上线 |

| 理解陌生代码库 | ⭐⭐⭐⭐⭐ | 公认最佳用途,几乎无副作用 |

| 小团队新功能 | ⭐⭐⭐⭐ | 先设计后实现,别让 AI 从零自由发挥 |

| Code Review 辅助 | ⭐⭐⭐⭐ | 让 AI 先扫一遍标可疑点,人再看 |

| 写测试 | ⭐⭐⭐⭐ | 生成测试骨架很好用 |

| 生产环境调试 | ⭐⭐⭐ | 当 rubber duck 用,别直接信结论 |

| 大型已有代码库 | ⭐⭐ | 局部辅助可以,别指望大改 |

| 不熟悉的技术栈 | ⭐ | 危险——你无法判断 AI 的错误 |

"当 AI 能瞬间生成代码,瓶颈就转移到了知道该要什么,和判断结果对不对。"

一位高级开发者 Dragos Nedelcu 写了篇文章,说自己 3 年用 AI 生成了 15 万行代码。直到有一天,AI 在 15 分钟内搞出了横跨 7 个文件的连锁 bug,他不得不 git reset 全部回滚。他写道:"我慢慢看着自己的技术能力退化……一边像玩老虎机一样玩 ChatGPT。"

还有一个开发者遇到产品经理用 ChatGPT 查资料:PM 说规格文档要求用"阿拉伯数字",但"根据 ChatGPT,这意味着要用阿拉伯文的数字符号"。花了好几轮会议、请来阿拉伯语翻译团队,才说服她 1234 就是阿拉伯数字。

这个开发者总结:"人们宁可信 LLM 也不信领域专家。我们完了。"

这指向一个比效率更深的问题:软件工程师的核心能力正在从"编码"迁移到"判断"。 手速和语法记忆在贬值,系统理解力和"这里看着不对"的直觉在升值。

但如果你让 AI 写了足够多的代码,有一天可能发现自己已经没有能力判断 AI 写的对不对了。不是 AI 替代了你的判断力——是你自己把它交出去了。

HN 上有人用自动驾驶打了个比方:"这让我想起那种要求你在不开车的情况下随时保持全神贯注、随时准备接管的自动驾驶。这显然不现实。"

数据来源:Hacker News 多个热帖(合计 1000+ 评论,2026/3/15)、Reddit r/ChatGPT & r/ClaudeAI、METR 随机对照实验、Faros AI 万人开发者报告、Stack Overflow 2025 调查、stavros.io

阅读原文:原文链接